Qwen 3 基准测试、对比、型号规格及更多信息

Qwen3:阿里巴巴最新的开源人工智能模型

Qwen3是阿里云最新一代大型语言模型 (LLM)。它由通义千问系列背后的团队打造,功能强大且灵活,并以 Apache 2.0 许可的开源软件包形式提供。

Qwen3 于2025 年 4 月 29 日发布,共有八种规格,包括密集模型(参数数量从 6 亿到 320 亿不等)和混合专家 (MoE)模型,例如旗舰级的Qwen3-235B。这些 MoE 模型每次只激活其总参数的一小部分(例如 2350 亿中的 220 亿),因此无需极高的计算资源即可获得高性能。

让我们深入了解一下它的一些关键特性。

型号尺寸和选项

以下是您可以选择的选项概览:

| 模型 | 类型 | 参数(总数/活动) | 最大上下文 |

|---|---|---|---|

| Qwen3-235B-A22B | 教育部 | 235B / 22B | 128K |

| Qwen3-30B-A3B | 教育部 | 30B / 3B | 128K |

| Qwen3-32B | 稠密 | 32B | 128K |

| Qwen3-14B | 稠密 | 14B | 128K |

| Qwen3-8B | 稠密 | 8B | 128K |

| Qwen3-4B | 稠密 | 4B | 32K |

| Qwen3-1.7B | 稠密 | 17亿 | 32K |

| Qwen3-0.6B | 稠密 | 0.6B | 32K |

所有模型均采用Apache 2.0许可,因此您可以在商业应用程序中使用它们,而无需担心法律问题。

基准测试与比较

以下基准测试评估了启用推理功能的 Qwen3。

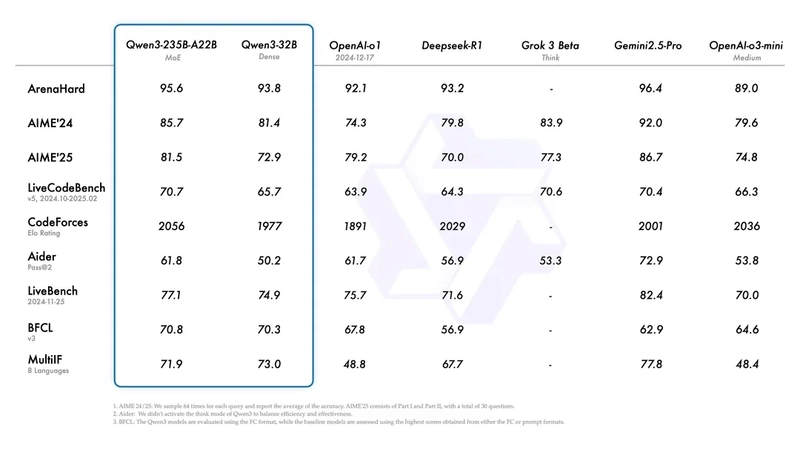

Qwen3-235B(旗舰型号)在 CodeForces ELO Rating、BFCL 和 LiveCodeBench v5 基准测试中领先,但在 ArenaHard、AIME、MultilF 和 Aider Pass@2 测试中落后于 Gemini 2.5 Pro:

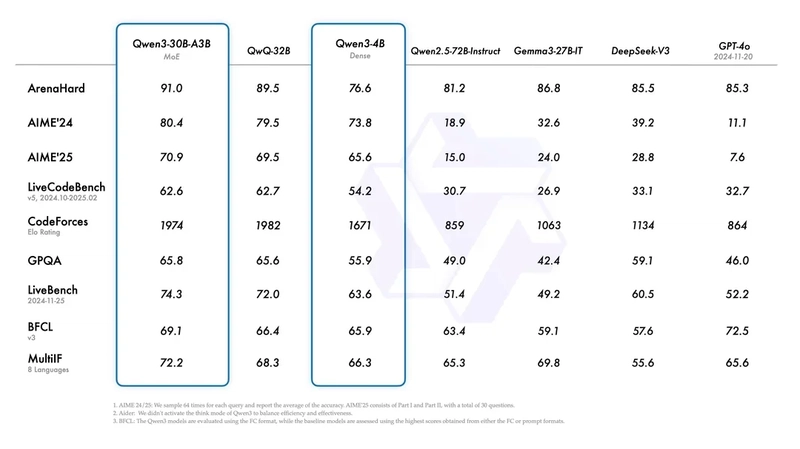

与开源和非前沿模型相比,Qwen3-30B(一款较小的模型)在速度和准确率方面都表现出色。在 LiveCodeBench 和 CodeForces 基准测试中,它仅次于阿里巴巴的另一款模型 QwQ-32B;在 BFCL 基准测试中,它则逊于 GPT-4o。

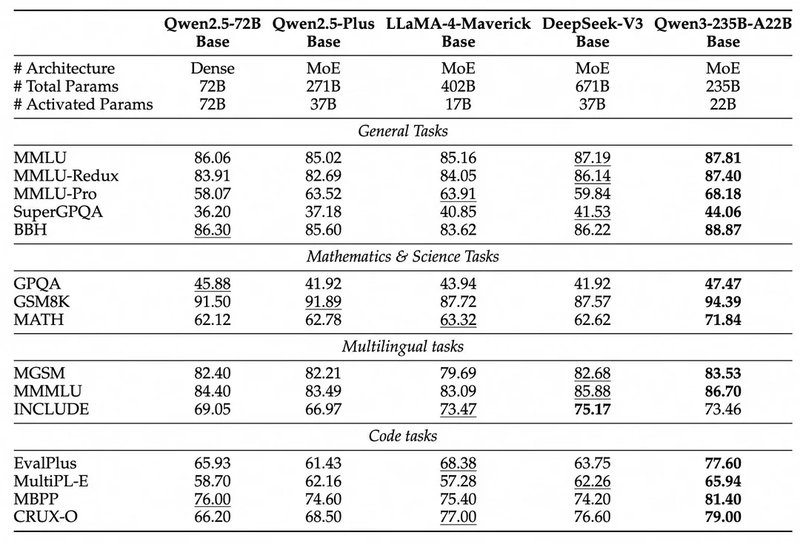

下面,尽管 Qwen3-235B 是第二小的模型,但在所有基准测试中,它都优于所有其他模型,除了在多语言任务基准测试中 DeepSeek v3 之外。INCLUDE

Qwen3 有哪些新特性?

双重“思考”模式

这是Qwen3最酷的功能之一:它可以在“思考模式”和“非思考模式”之间切换。“思考模式”用于深度推理,例如针对复杂任务进行层层深入的思考。“非思考模式”则省略繁琐的步骤,提供快速简洁的答案。

因此,根据提示或任务的不同,Qwen3 可以选择深入思考或直奔主题。这意味着在需要时提供更快的速度,在需要时提供更深入的思考。

更智能规模化的教育部

Qwen3之所以能够处理如此庞大的参数数量,正是得益于其混合专家(MoE)架构。它并非每次都使用所有参数,而是每个令牌仅激活少数几个“专家”。例如,Qwen3-235B一次只使用220亿个激活参数,因此其运行成本远低于预期。

这是在不花费大量预算购买 GPU 的情况下扩展规模的明智方法。

使用涵盖 119 种语言的 36 万亿个词元进行训练

Qwen3 使用包含约 36 万亿个词元的大型数据集进行训练,其中包括网页数据、书籍、PDF 以及早期 Qwen 模型生成的合成代码/数学公式。它现在能够理解119 种语言和方言,使其成为目前最强大的多语言模型之一。

无论你使用英语、中文还是其他资源匮乏的语言,Qwen3 都可能随时准备为你提供帮助。

更智能的代理和更优秀的程序员

Qwen3 不仅仅接受过口语训练。阿里巴巴还注重工具使用、规划和编程,这使得这一代人在以下方面表现得更加出色:

- 编写和调试代码

- 逐步解决数学和逻辑问题

- 扮演一个能够使用工具或浏览网页的人工智能代理

事实上,据报道, Qwen3-4B在编程等任务上甚至比一些早期的 72B 型号表现更好。

入门

您可以从以下位置获取模型:

您还可以在他们的GitHub 页面上找到详细的指南、分词器信息和微调说明。

最后想说的话

Qwen3是目前最好的开源LLM之一。当然,鉴于新模型发布的速度,这种情况可能很快就会改变。

感谢阅读!

BestCodes

文章来源:https://dev.to/best_codes/qwen-3-benchmarks-comparisons-model-specifications-and-more-4hoa本文部分内容由人工智能生成。