法学硕士入门:实用手册

在人工智能(AI)这个快速发展的领域,理解基础知识至关重要,尤其是在处理大型语言模型(LLM)时。本指南旨在为初学者简化复杂的概念,带您了解神经网络、自然语言处理(NLP)和大型语言模型等基本概念。我们将探讨大型语言模型的构建和训练方法,以及与大型语言模型相关的关键词,并分析它们面临的挑战,例如偏差和幻觉。

什么是神经网络?

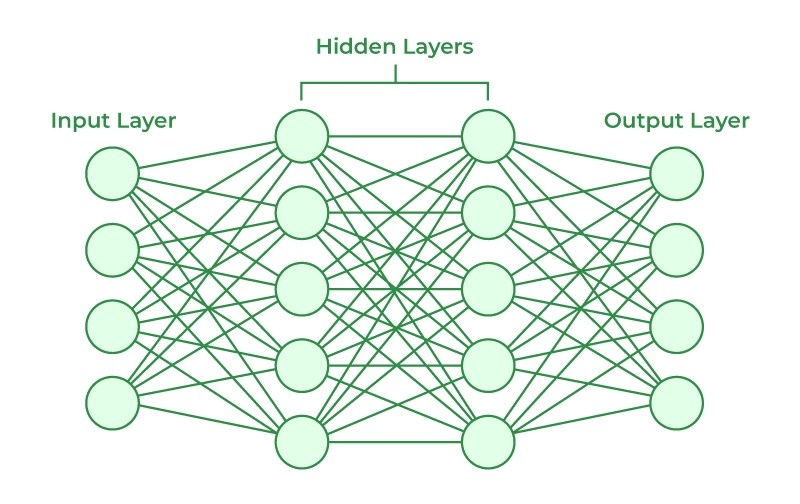

神经网络是一种机器学习模型,它像人脑一样做出决策,通过模仿生物神经元协同工作来识别模式、评估选择并得出结论。神经网络是所有人工智能模型(包括逻辑学习模型)的基石。作为人工智能模型(包括逻辑学习模型)的基石,神经网络被组织成多个层,用于处理数据并从中学习。神经网络中的神经元按层排列:

- 输入层:数据首次进入模型的地方。

- 隐藏层:进行计算的地方,使网络能够学习模式。

- 输出层:做出最终预测或决策的地方。

例如,可以训练神经网络来识别猫的图像。它通过多层神经元处理图像,从而能够在不同的形状或物体中识别出猫。

什么是自然语言处理(NLP)?

自然语言处理(NLP)是指计算机程序理解人类语言(包括口语和书面语)的能力。NLP 专注于使机器能够理解和生成人类语言。从聊天机器人到语音助手,NLP 为各种应用提供支持,将人类语言翻译成机器可以处理的形式。它涉及的任务包括:

- 分词:将文本分解成更小的组成部分(例如,单词或子词)。

- 句法分析:理解句子的结构。

- 情感分析:判断一段文本是积极的、消极的还是中性的。

如果没有自然语言处理技术,法学硕士就无法掌握人类语言的细微差别。

什么是大型语言模型(LLM)?

大型语言模型(LLM)是旨在理解和生成人类语言的高级神经网络。它们通过海量文本数据进行训练,从而学习语言的模式、上下文和细微差别。LLM 可以执行各种任务,例如回答问题、撰写文章、翻译语言以及进行对话。它们的主要目标是生成能够捕捉自然语言复杂性的类人文本。

语言学习模型(LLM)的核心理念很简单:预测句子中的下一个词。例如,如果您输入“太阳从……升起”,LLM 应该预测“东”。虽然这看起来很基础,但这项任务能够培养复杂的、涌现的能力,例如文本生成、推理,甚至创造力。

法学硕士关键术语

变形金刚

Transformer 是一种神经网络架构,它通过使模型能够更高效地处理数据序列,彻底革新了自然语言处理 (NLP) 技术。Transformer 架构最早发表于一篇开创性的论文中Attention Is All You Need。传统的循环神经网络 (RNN) 模型处理序列数据并维护内部状态,使其能够处理类似句子的序列。然而,由于梯度消失问题等原因,它们在处理长序列时会遇到困难,因为随着时间的推移,它们会遗忘早期的信息。这是因为为改进模型而进行的调整幅度太小,以至于无法产生任何实际效果。

Transformer模型通过使用一种名为“注意力机制”的方法解决了这些挑战。该机制使模型能够更有效地关注句子或文档的不同部分,而无需考虑它们的位置。这项创新为GPT-4、Claude和LLaMA等突破性模型奠定了基础。

该架构最初设计为编码器-解码器框架。在这种架构中,编码器处理输入文本,提取关键部分并创建其表示。解码器随后将这种表示转换回可读文本。这种方法适用于摘要等任务,解码器可以根据传递给编码器的输入生成摘要。编码器和解码器可以协同工作,也可以独立工作,从而为各种任务提供灵活性。一些模型仅使用编码器将文本转换为向量,而另一些模型则完全依赖于解码器,解码器是大型语言模型的基础。

语言建模

语言建模是指教会语言学习模型(LLM)理解语言中词语的概率分布的过程。这使得模型能够预测句子中最有可能出现的下一个词,这是生成连贯文本的关键任务。生成连贯且符合上下文的文本的能力在许多应用中都至关重要,例如文本摘要、翻译或对话代理。

分词

词法分析是使用大型语言模型(LLM)的第一步。它指的是将句子分解成更小的部分,称为词元(token)。根据模型的不同,这些词元可以是单个字母,也可以是整个单词,而词元的分割方式会影响模型的性能。

例如,考虑以下句子:The developer’s favorite machine.。

如果我们按空格分割文本,会得到:

["The", "developer's", "favorite", "machine."]

这里,像撇号developer’s和句末句号这样的标点符号machine.仍然与单词相连。但我们也可以根据空格和标点符号来拆分句子:

["The", "developer", "'", "s", "favorite", "machine", "."]

文本被分割成词元的方式取决于模型,许多高级模型使用诸如子词分词之类的方法。这种方法将单词拆分成更小、更有意义的部分。例如,句子It's raining可以拆分成:

["It", "'", "s", "rain", "ing", "."]

在这种情况下,单词raining被拆分成词根rain和词尾ing,这有助于模型理解单词的结构。通过将单词拆分成词根和词尾(例如,单词的词尾是rain和),模型可以更有效地学习词义,而无需存储每个单词的不同版本。ingraining

在分词过程中,文本会被扫描,每个词元都会被分配一个字典中的唯一ID。这使得模型在处理文本时能够快速查阅字典,从而让输入更容易理解和处理。

嵌入

词元化之后,下一步是将这些词元转换成计算机可以处理的格式——这可以通过词嵌入来实现。词嵌入是一种将词元(单词或单词的一部分)表示为计算机可以理解的数字的方法。这些数字有助于模型识别单词及其上下文之间的关系。

例如,假设我们有单词“a”happy和joyful“b”。模型会为每个单词分配一组数字(即词嵌入),以捕捉其含义。如果两个单词相似,例如“a”happy和joyful“b”,即使它们不同,它们的词嵌入值也会很接近。

起初,模型会为每个词元分配随机数。但随着模型不断训练——通过读取和学习大量文本——它会调整这些数字。其目标是使含义相近的词元拥有相似的数字组合,从而帮助模型理解它们之间的联系。

虽然听起来很复杂,但词嵌入其实就是一系列数字,它能让模型高效地存储和处理信息。使用这些数字(或向量)可以让模型更容易理解词元之间的关系。

让我们来看一个简单的嵌入示例:

假设我们有三个词:cata、dogb 和carc。模型会为每个词分配一组数字,如下所示:

cat→ [1.2, 0.5] dog→ [1.1, 0.6] car→ [4.0, 3.5]

这里,“动物”cat和dog“猫”的数字相近,因为它们都是动物,所以它们的含义相关。另一方面,“汽车”的数字则截然不同,因为它是一种交通工具,而不是动物。

训练和微调

大型语言模型(LLM)通过阅读海量文本进行训练,学习如何预测句子中的下一个词。该模型的目标是根据其在文本中观察到的模式调整内部设置,从而提高预测的准确性。最初,LLM 使用来自互联网的通用数据集进行训练,例如The Pile或CommonCrawl,这些数据集涵盖了广泛的主题。对于特定领域的知识,模型还可以使用专门的数据集进行训练,例如Reddit 帖子,这有助于模型学习编程等特定领域。

这个初始训练阶段称为预训练,在此阶段,模型会学习理解语言的整体含义。在这个阶段,模型的内部weights设置会进行调整,以帮助它根据训练数据更准确地预测下一个词。

预训练完成后,模型通常会进入称为微调的第二阶段。在微调阶段,模型会在规模较小的、专注于特定任务或领域的数据集上进行训练,例如医学文本或财务报告。这有助于模型将预训练期间学习到的知识应用到特定任务中,从而更好地完成任务,例如文本翻译或回答特定领域的问题。

对于像 GPT-4 这样的高级模型,微调需要复杂的技术,甚至需要更多的数据才能达到其令人印象深刻的性能水平。

预言

经过训练或微调后,模型可以通过预测句子中的下一个词(更准确地说是下一个词元)来生成文本。它通过分析输入文本,并根据每个可能的下一个词元出现的可能性为其赋予一个分数来实现这一点。得分最高的词元会被选中,并且这个过程会针对每个新的词元重复进行。这样,模型就可以生成任意长度的句子,但需要注意的是,模型一次只能处理一定量的文本作为输入,这被称为它的上下文大小。

上下文大小

上下文大小(或上下文窗口)是层级逻辑模型(LLM)的关键参数。它指的是模型在单次请求中可以处理的最大词元数。上下文大小决定了模型一次可以处理多少信息,这会影响模型的性能和输出质量。

不同的模型具有不同的上下文大小。例如,OpenAI 的 gpt-3.5-turbo-16k 模型最多可以处理 16,000 个词元(词元可以是单词的一部分,也可以是单词本身)。较小的模型可能只能处理 1,000 个词元,而像 GPT-4-0125-preview 这样的大型模型则可以处理多达 128,000 个词元。这个限制会影响模型一次可以生成的文本量。

尺度定律

扩展定律解释了语言模型的性能如何受到不同因素的影响,例如参数数量、训练数据集的大小、可用计算能力以及模型设计。这些定律在Chinchilla论文中有所讨论,它们有助于我们理解如何最佳地利用资源来有效地训练模型,并为优化性能提供了思路。根据扩展定律,以下要素决定了语言模型的性能:

- 参数数量 (N):参数就像模型的微小组成部分,

brain帮助模型学习。当模型读取数据时,它会调整这些参数以更好地理解数据模式。模型拥有的参数越多,就越智能,这意味着它能够捕捉到数据中更复杂、更细致的模式。 - 训练数据集大小(D):训练数据集是模型用来学习的文本或数据集合。训练数据集越大,模型就能学习和识别更多不同文本中的模式。

- FLOPs(每秒浮点运算次数):该术语指的是训练模型所需的计算能力。它衡量模型在训练过程中处理数据和执行计算的速度。FLOPs 值越高,意味着模型能够处理更复杂的任务,但也需要更多的计算资源。

法学硕士中的涌现能力

随着语言学习模型(LLM)规模和复杂性的增长,它们开始展现出一些并非预先编程实现的涌现能力。例如,GPT-4 能够概括长篇文本,甚至执行基本的算术运算,而无需专门针对这些任务进行训练。这些能力的涌现是因为模型在训练过程中学习了大量关于语言和数据的知识。

提示

提示是您向语言学习管理系统 (LLM) 发出的指令,用于生成所需的输出。设计合适的提示可以显著提高生成文本的质量。例如:

1. 使用清晰易懂的语言:

为了获得更好的结果,请在提示语中尽量具体。

- 不太清楚:写写阿拉玛·伊克巴尔。

- 更清晰:写一篇 500 字的文章,介绍次大陆伟大的诗人阿拉玛·伊克巴尔。

2. 提供足够的背景信息:

上下文有助于模型了解你的需求。

- 减少背景信息:写一个故事。

- 更多背景信息:写一个关于女婴在森林里迷路的短篇故事,结局要美好。

3. 尝试不同的变化:

尝试不同的提示方式,看看哪种效果最好。

- 原文:写一篇关于编程益处的博客文章。

- 方案一:写一篇 1000 字的博客文章,论述定期练习编程对心理和经济的好处。

- 方案二:撰写一篇引人入胜的博客文章,重点介绍编程的十大好处。

4. 审核输出结果:

分享前请务必检查自动回复的准确性。

幻觉

当逻辑推理模型(LLM)生成与事实不符或毫无意义的内容时,就会出现幻觉。例如,LLM可能会说“澳大利亚的首都是悉尼”,而正确答案是堪培拉。这是因为模型专注于根据训练数据生成看似合理的文本,而不是验证事实。

偏见

当训练数据反映出文化、性别或种族偏见时,语言学习模型(LLM)就会出现偏差。例如,如果一个模型主要使用来自西方来源的英文文本进行训练,它可能会产生偏向西方视角的有偏输出结果。尽管人们正在努力减少这些偏差,但它们仍然是该领域面临的一项重大挑战。

文章来源:https://dev.to/umairian/introduction-to-llms-a-useful-handbook-2po