使用 Electron UI 评估 LLM 和提示 🤖 💬

这个用户界面有什么用?🤨

学习逻辑模型(LLM)正日益成为各行各业的常用工具。然而,能否取得最佳效果很大程度上取决于能否选择正确的模型和提示。由于需要大量的反复试验,这个过程可能非常耗时。

本文旨在介绍一款用于简化各种模型和提示测试流程的工具。借助该工具,开发人员可以高效地找到最有效的组合。

特别感谢 Kevin Brisson 创建了这个 Electron UI!您可以在这里找到他的工具的 GitHub 代码库:https://github.com/kbrisso/ai-base

注意:本文提供的命令行界面 (CLI) 命令专为 Linux/Mac 系统设计,可能无法在 Windows 系统上正常运行。如果遇到任何问题,请将不兼容的命令替换为对应的 Windows 命令。

一步一步教你如何启动并运行这个工具!

(如果您想观看设置演示视频,请点击此处)

1. 首先,让我们克隆仓库💻

导航到您选择的目录,然后git clone https://github.com/kbrisso/ai-base在命令行中运行。

2. 根目录安装📦

在命令行中导航到根目录ai-base并运行命令npm install。如果遇到错误,请运行命令npm audit fix。这将修复软件包中的任何漏洞。

3. llmware-wrapper 安装 📦

在命令行中导航到该目录llmware-wrapper,并运行与上面完全相同的命令:npm install如果npm audit fix出现错误。

4. 创建虚拟环境并安装软件包💾

在与上述相同的目录中llmware-wrapper,创建一个新的虚拟环境:python3 -m venv venv。

source venv/bin/activate然后通过在命令行运行命令进入虚拟环境。

然后运行pip install -r requirements.txt以安装所需的软件包。

最后,运行以下命令停用虚拟环境deactivate

5. 复制本地 Python 路径 🐍

llmware-wrapper.properties在 IDE 的文件资源管理器中,打开目录中名为的文件llmware-wrapper。

在这个文件中,删除变量已设置的路径pythonpath,并将其替换为本地 Python 解释器的路径。

如果您不知道本地路径,请which python在命令行中运行,然后将结果复制并粘贴到您删除先前路径的位置。

让我们开始用户界面吧!🚀

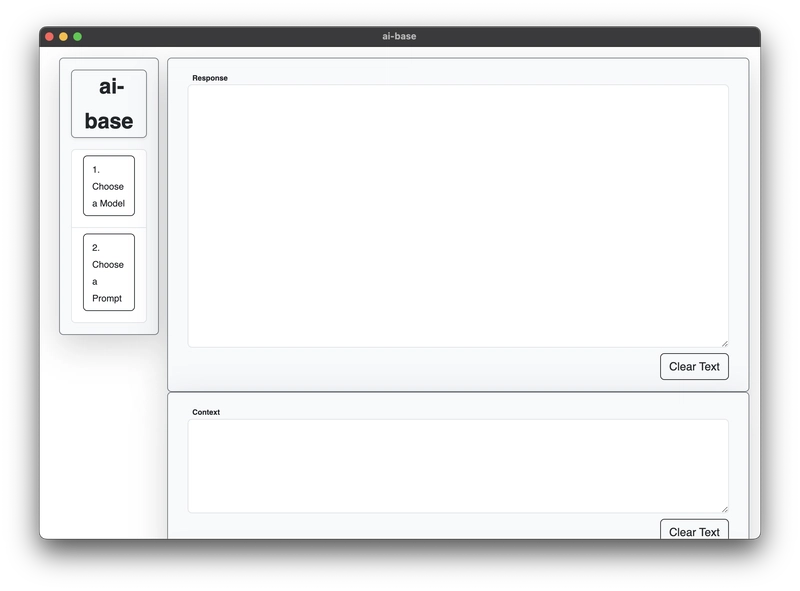

ai-base在命令行中导航到根目录并运行命令npm start。几秒钟后,用户界面窗口应该会弹出。

选择模特和提示💡

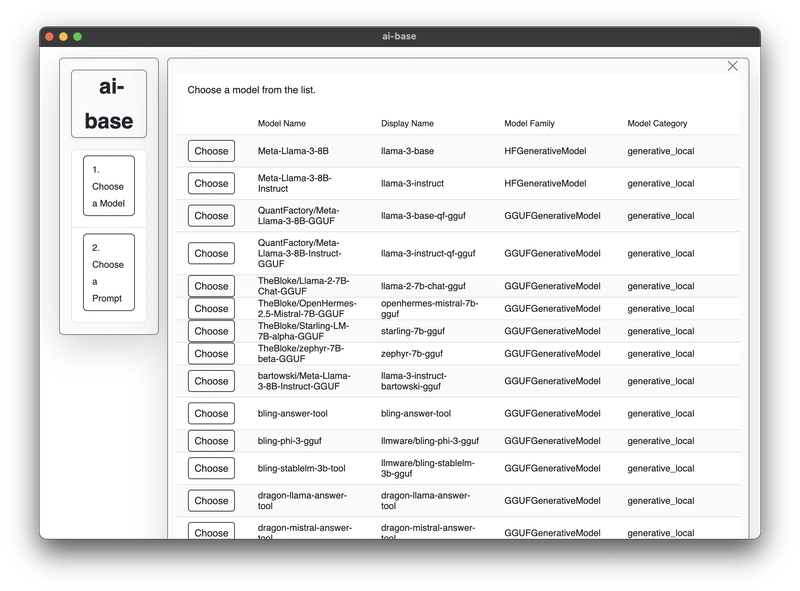

点击“选择型号”按钮。这将显示LLMWare提供的所有可用型号。找到您想尝试的型号后,点击型号名称旁边的“选择”按钮。

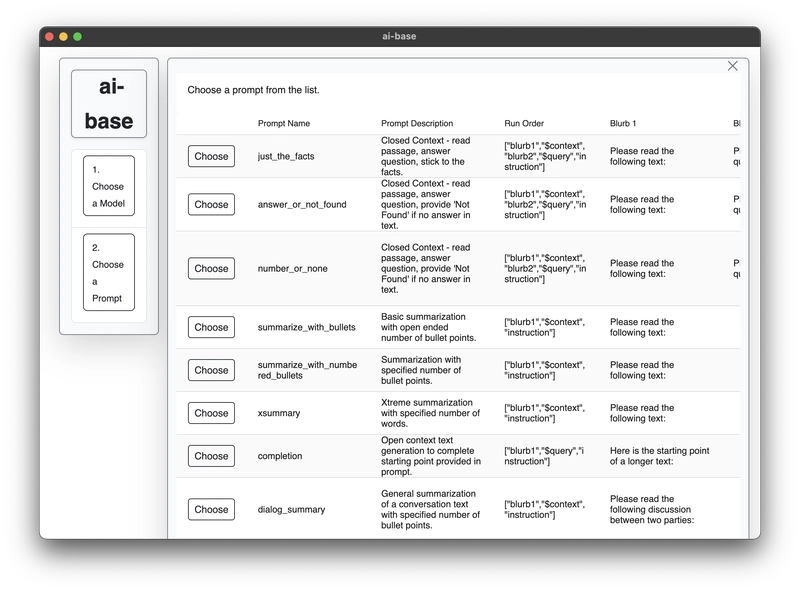

点击“选择提示”按钮。这将显示LLMWare提供的所有可用提示类型。此外,您还可以在提示名称右侧找到有关提示类型的补充信息,例如描述。找到想要尝试的提示类型后,点击提示名称旁边的“选择”按钮。

把所有东西整合起来……🧩

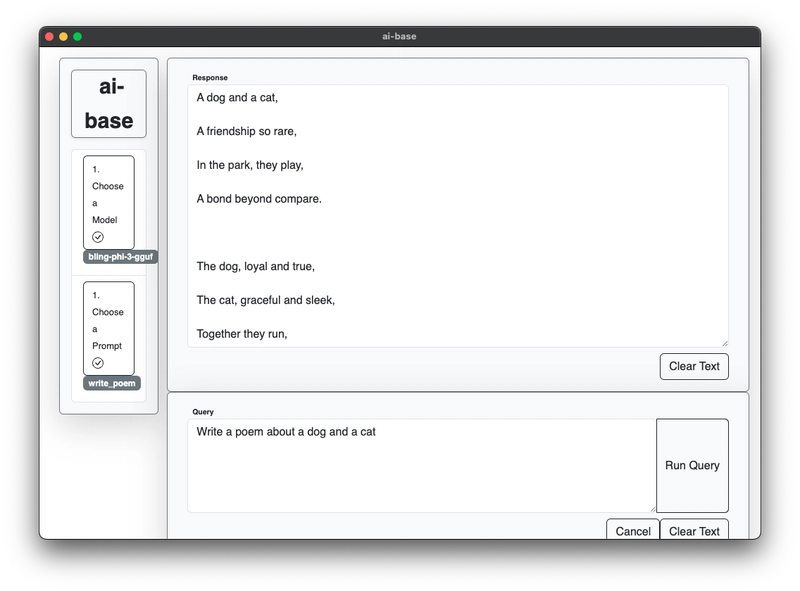

选择模型和提示类型后,就可以开始查询了!只需在标有“查询”的框中输入查询内容,然后点击“运行查询”按钮。稍等片刻,响应结果将显示在名为“响应”的框中。

注意:根据所选提示类型,可能会出现一个额外的上下文输入框。如有需要,您可以在此空间提供与查询相关的详细信息。

现在您可以轻松地尝试不同的模型和查询!

结论🏁

找到合适的模型和提示组合对于创建可靠有效的学习领导力工具至关重要。利用此用户界面,您可以比以往任何时候都更快地找到最佳组合!

请访问我们的 GitHub 页面并点个赞!https://github.com/llmware-ai/llmware

请在此处加入我们的Discord服务器:https://discord.gg/MgRaZz2VAB

请访问我们的网站llmware.ai获取更多信息和最新动态。

文章来源:https://dev.to/llmware/evaluating-llms-and-prompts-with-electron-ui-4jkl